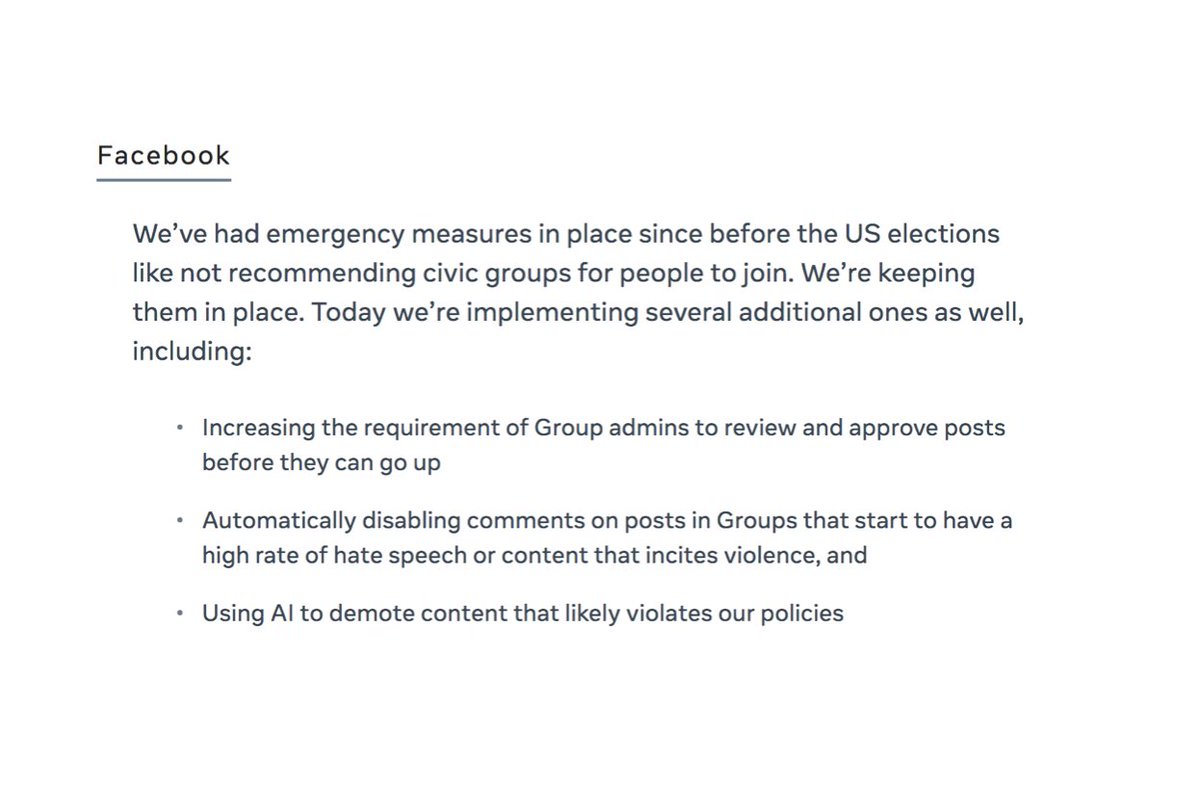

Ayer, entre el ruido y el caos del asalto al Capitolio, Facebook publicó un comunicado importante: la red social va a tomar medidas contra el contenido que fomenta el odio y la violencia dentro de su función “Grupos”.

¿Qué significa esto? y ¿Por qué ahora y no antes?

1/

¿Qué significa esto? y ¿Por qué ahora y no antes?

1/

Primero hay que entender que supone “Grupos” para Facebook. A finales de 2016, los directivos de la red social se enfrentaban a una dura realidad: los usuarios cada vez pasaban menos tiempo en su producto.

2/

2/

La dura competencia de Instagram (propiedad de Facebook, pero que canibalizaba a su audiencia), el envejecimiento de sus usuarios y la falta de innovación estaban haciendo mella en sus resultados.

3/

3/

Pero había una esperanza: los grupos. Los datos internos reflejaban que los usuarios que pertenecían a un grupo activo pasaban mucho más tiempo que la media en Facebook.

La estrategia estaba clara. Había que potenciarlos.

4/

La estrategia estaba clara. Había que potenciarlos.

4/

A principios de 2017 Mark Zuckerberg publicó en su perfil una extensa reflexión detallando su plan para el futuro de la red social: los grupos son la parte central de la experiencia de Facebook.

5/

5/

De aquí en adelante, Facebook potenciaría la función “Grupos” para hacerla más atractiva y conocida. Tras años de trabajo, la estrategia culminó con la publicación de este anuncio durante la Superbowl de 2020 ante millones de estadounidenses.

6/

6/

Pero el plan no se quedo sólo en un anuncio. La clave de la estrategia fue el algoritmo de recomendación: utilizando los datos de los usuarios, Facebook recomendaría sin descanso grupos afines para intentar que se unieran y aumentar así el tiempo que pasan en su producto.

7/

7/

Y funcionó a la perfección. Facebook multiplicó por 4 las personas que estaba en un grupo activo en 3 años y además consiguió sumar 400 millones de usuarios más a su función de grupos, alcanzando los 1.800 millones de usuarios activos al mes.

8/

8/

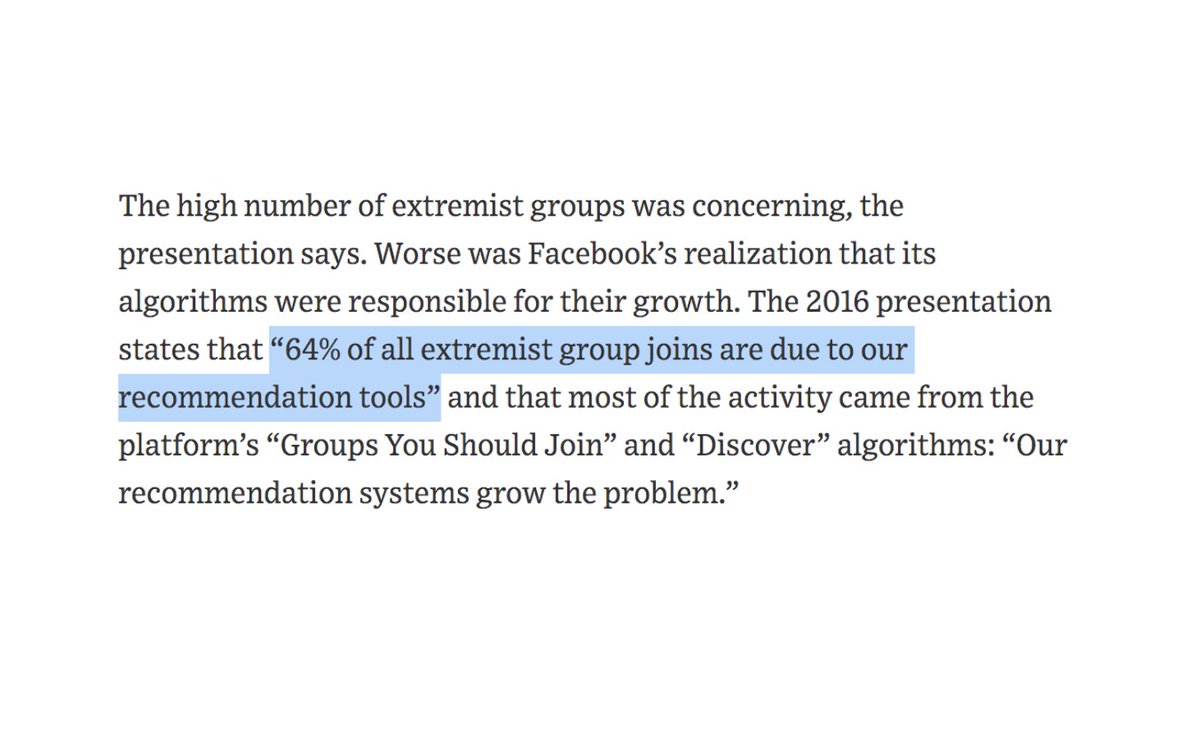

¿El problema? Que los directivos de Facebook sabían desde el principio que las organizaciones extremistas utilizaban estos grupos privados para fomentar el odio y la violencia. Informes internos de 2016 revelados por el @WSJ así lo señalan.

9/

9/

Y no solo esto. Facebook también era consciente de que las organizaciones extremistas se aprovechaban enormemente su sistema de recomendación. Un 64% de los nuevos miembros de estos grupos entraban gracias a las recomendaciones de Facebook.

10/

10/

A pesar de conocerlo, Facebook siguió adelante. Y obviamente su plan tuvo consecuencias. Este artículo de @guardian señala como los grupos conspiranoicos de QAnon alcanzaban los 4.5 millones de miembros en la red social para agosto de 2020.

11/ https://www.theguardian.com/us-news/2020/aug/11/qanon-facebook-groups-growing-conspiracy-theory

11/ https://www.theguardian.com/us-news/2020/aug/11/qanon-facebook-groups-growing-conspiracy-theory

Muchos fieles creyentes de la conspiración de QAnon estaban ayer en la manifestación en el Capitolio e incluso había numerosos miembros de este culto entre los que entraron en el edificio.

12/ https://www.buzzfeednews.com/article/katienotopoulos/qanon-believers-stormed-the-capitol

12/ https://www.buzzfeednews.com/article/katienotopoulos/qanon-believers-stormed-the-capitol

De ahí que Facebook se haya dado mucha prisa por implementar medidas para combatir el contenido que fomenta el odio y la violencia en los “Grupos”.

Muchos expertos y analistas en Estados Unidos están señalando a la red social como cómplice de lo ocurrido.

13/

Muchos expertos y analistas en Estados Unidos están señalando a la red social como cómplice de lo ocurrido.

13/

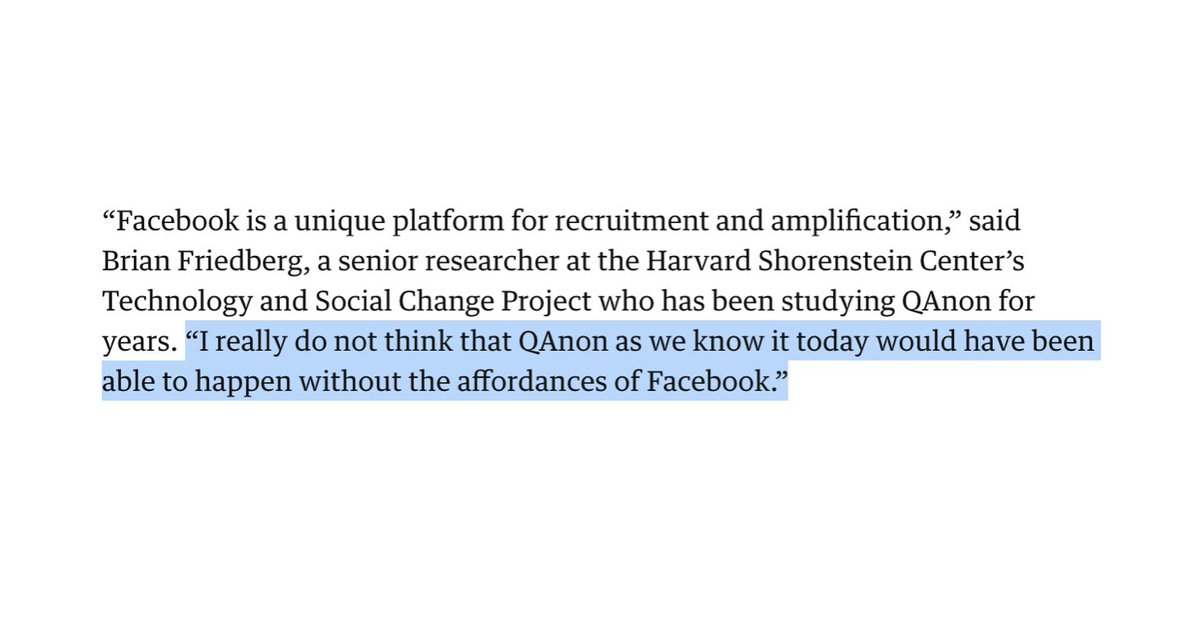

Si bien QAnnon no nació en Facebook (lo hizo en foros de internet como 4chan), la red social ha sido clave en su popularización. Gracias a su algoritmo de recomendación, esta teoría de la conspiración ha alcanzado a millones de personas.

14/ https://www.theguardian.com/technology/2020/jun/25/qanon-facebook-conspiracy-theories-algorithm

14/ https://www.theguardian.com/technology/2020/jun/25/qanon-facebook-conspiracy-theories-algorithm

Diferentes investigadores coinciden en que QAnon no sería lo que es hoy sin la existencia de Facebook. La enorme capacidad de reclutamiento y amplificación de la red social ha logrado que un oscuro movimiento minoritario alcance a las masas.

15/

15/

Ésta no es la primera vez que FB impone medidas sobre sus grupos. Las críticas a su funcionamiento han sido constantes en los últimos años y como respuesta la red social ha perseguido en varias ocasiones a los grupos extremistas, entre ellos QAnon.

https://www.theverge.com/2020/10/6/21504887/facebook-qanon-ban-all-apps-pages-groups-instagram-accounts

16/

https://www.theverge.com/2020/10/6/21504887/facebook-qanon-ban-all-apps-pages-groups-instagram-accounts

16/

Pero diferentes informes externos coinciden en que el problema con el contenido violento y de odio sigue vigente en Facebook. El propio funcionamiento de grupos (privacidad, falta de moderación) lo fomenta.

17/ https://www.adl.org/blog/hateful-and-conspiratorial-groups-on-facebook

17/ https://www.adl.org/blog/hateful-and-conspiratorial-groups-on-facebook

Ejemplo de ello es lo que reportaba el periodista @RMac18 hace solo 2 días: grupos en Facebook promoviendo las movilizaciones en Washington para el 6 de enero.

18/ https://twitter.com/RMac18/status/1346521076839239680?s=20

18/ https://twitter.com/RMac18/status/1346521076839239680?s=20

Algunos enlaces interesantes sobre el tema. Aquí puedes encontrar el comunicado completo de Facebook:

19/ https://about.fb.com/news/2021/01/responding-to-the-violence-in-washington-dc/

19/ https://about.fb.com/news/2021/01/responding-to-the-violence-in-washington-dc/

Un breve análisis del éxito de la dirección de Facebook en el cambio iniciado en 2017, para convertir a los "grupos" en una parte fundamental de la red social.

20/ https://www.cnbc.com/2020/02/16/zuckerbergs-focus-on-facebook-groups-increases-facebook-engagement.html

20/ https://www.cnbc.com/2020/02/16/zuckerbergs-focus-on-facebook-groups-increases-facebook-engagement.html

Dos buenos artículos sobre el problema de los grupos de Facebook y el contenido extremo. Éste de @WIRED, que en junio ya anticipaba el peligro que tenían para la sociedad estadounidense.

21/ https://www.wired.com/story/facebook-groups-are-destroying-america/

21/ https://www.wired.com/story/facebook-groups-are-destroying-america/

Read on Twitter

Read on Twitter